我现在公司内部有一个很强的ai平台,它最让我惊讶的是它已经完全接入了公司内部文档,通过与ai的唠嗑可以了解业务(甚至可以得到业务相关的核心应用和数据库信息),还可以快速的用起来各平台对应的api,导致我最近几乎每天都在跟ai唠嗑。

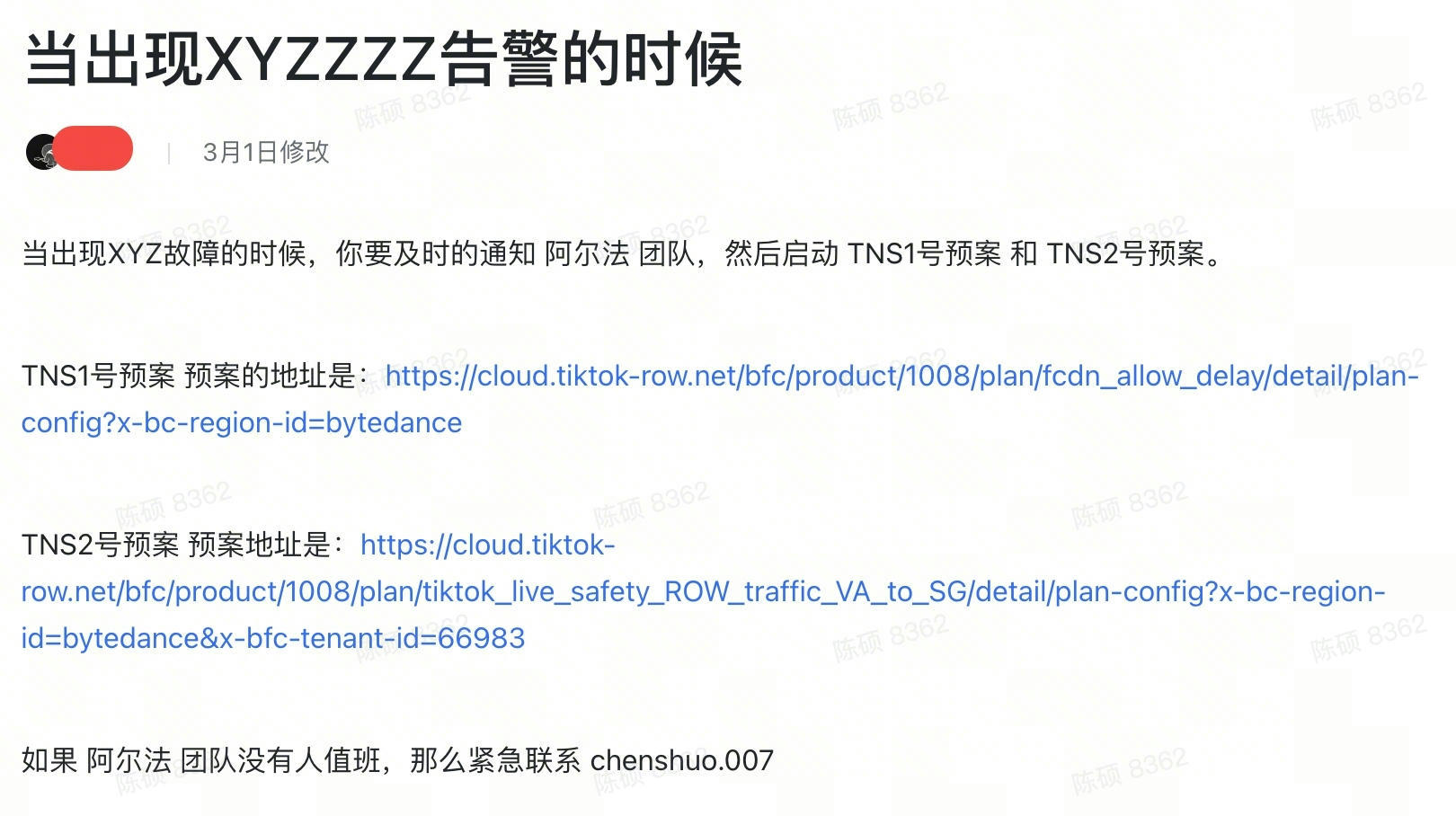

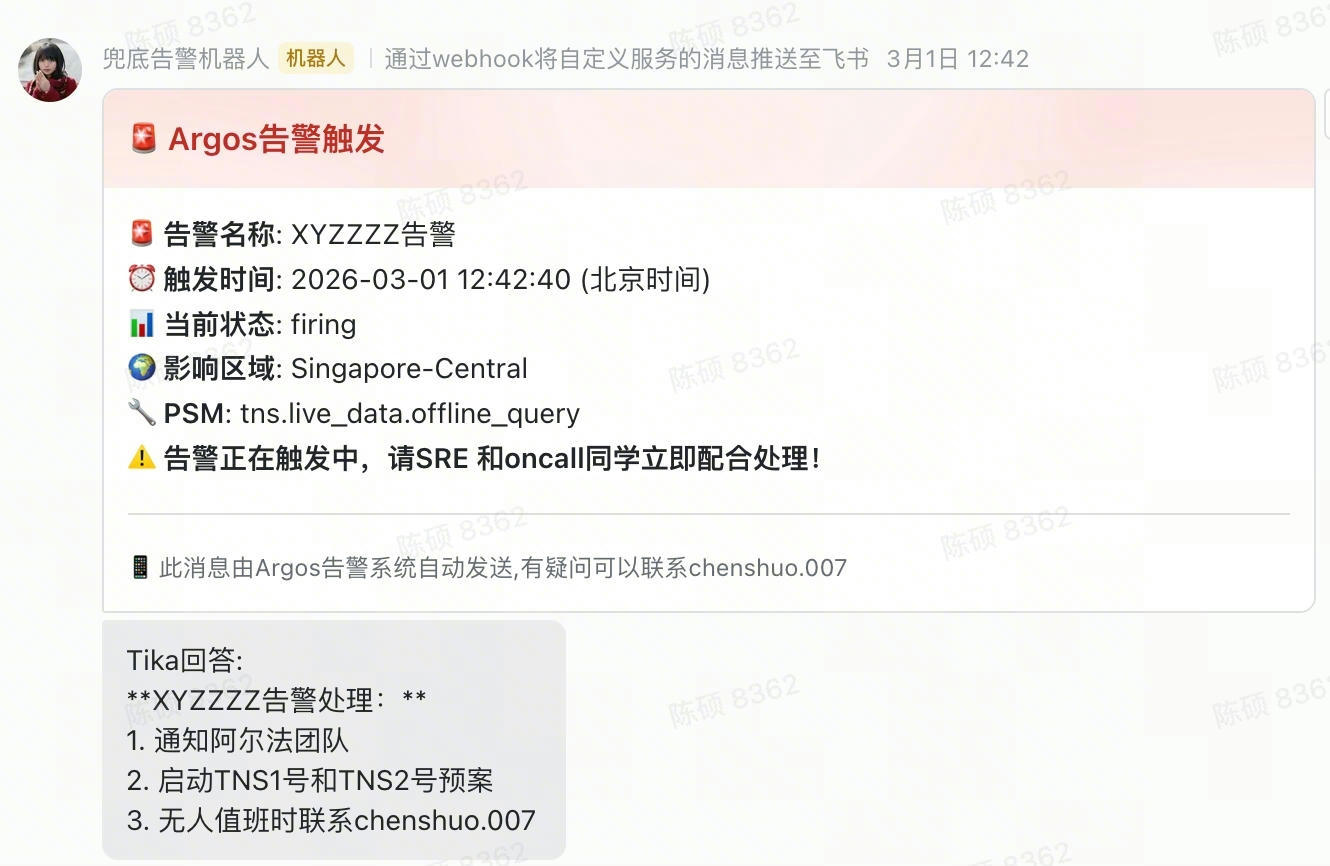

举给例子,我在公司文档里随便乱写了一个内容,然后把保密等级调整到L2(公开):

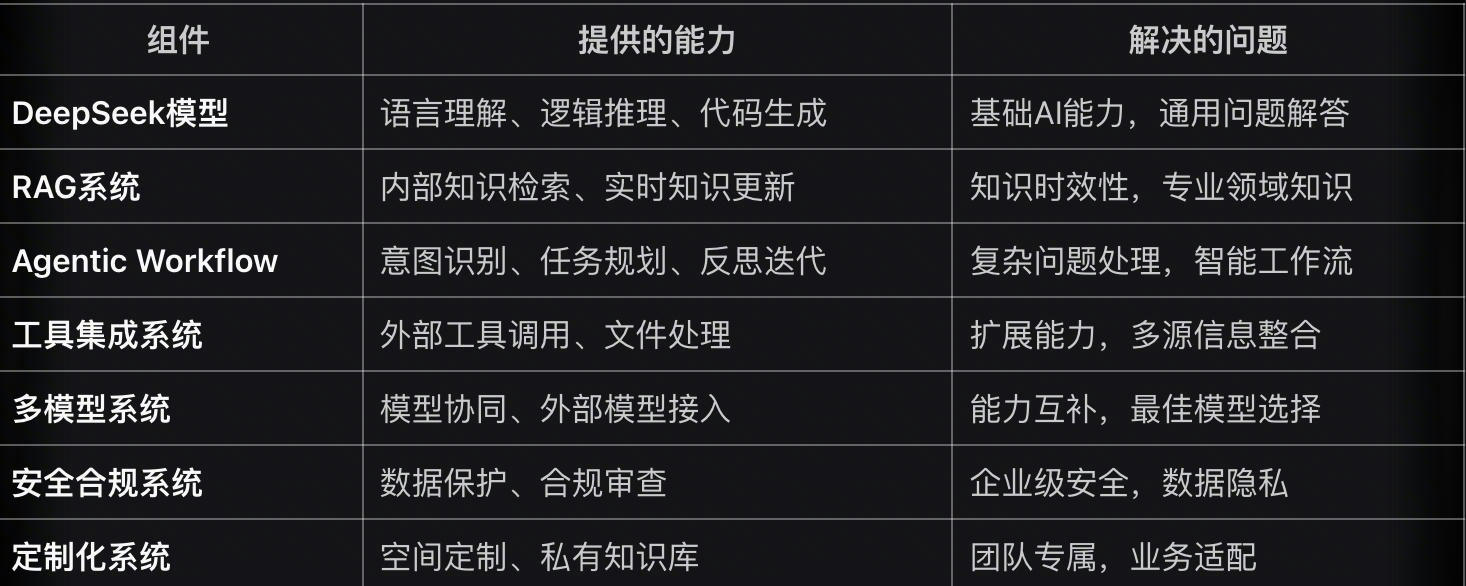

我让ai自己讲述了一下,它主要有这么几个能力:

从上面这个表可见这个ai的底层大模型是DeepSeek V3.2,RAG 的能力则是公司内部做的,它好就好在关联了公司内部十几万篇内部文档和高质量技术文章。这样的后果就是如果我要开发的话,直接问一下ai“ XX 的api是啥,请给我写一个demo”,马上ai就能反馈给你一个demo,你只需要看看代码改一改就能用(毕竟ai还是有些胡编乱造的情况),所以开发落地速度非常的快。

为什么我这么爱RAG?因为这代表就是以后不用专门的写配置文件了,以前的配置文件都是yaml json这样的格式,而现在直接就用文档,文档的格式就太多元了,表格也行,图片说明也行,无疑让人读起来更友好。不过这里有一个关键点,就是文档里不可以有“互斥”的地方,比如第一篇文档写了“A监控告警的时候,要执行B预案”,结果下一篇文档却写了“A监控告警的时候,千万不要执行B预案”,那这样ai就蒙了,它会根据文章发布的先后新旧顺序和文章属性(官方文档还是个人笔记)来抉择,虽然这里有抉择,但是还是让ai困惑。

所以我觉得,将来这部分的文档也要引入“质量门禁”,让大家一起来评审 and 一起来验证文档一致性,把“不爱说主语的甚至话说不明白”的作者都纠正过来。

于是乎,我们未来工作的思路也要转变:

1 | 以前:人 → 学习语法 → 写配置 → 机器 |

所以我觉得SRE未来应该开发一个 AI SRE agent,这才是未来工作的王道!

但是越用ai你越发现,它目前还是一个工具,它不能给你直接提供灵感,目前看最好的合作方式是“你在工作中发现要做什么,然后告诉ai,ai能快速落地”,所以目前看这个世界属于“更了解痛点、更了解业务、更了解趋势的人”,因为他们才会知道让ai做什么。

还有一个注意的点!ai token的计费 = 输入token费用 + 输出token费用。其中:

- 输入token:包括用户的问题(query)和检索到的上下文内容。所以别说弯弯绕绕的废话,简单清晰的去告诉ai需求。

- 输出token:模型实际返回给用户的回答内容。

- 思考过程不会返回给用户,因此不计费。但是我不是说“深度推理”这个功能没用啊,如果是简单的问题,比如“新中国是哪年成立的”,这种就不用开“深度推理”,但是如果你要ai深度的帮你设计一个方案,需要发散思维的时候,“深度推理”功能还是要开的,这点钱该花还是要花。

但是随着我用ai越来越多,我发现了一个致命的问题。就是我公司这个ai,他的大模型是deepseek 3.2,知识截止到了2024年,RAG能力是检索全公司的文档。但是如果你问他的是“2024年之后且全公司文档里没有的东西”,它就傻眼了。比如公司的grafana是最新的版本,结果只有2024年能力的它根本无法解决我最新的grafana配置的问题。